Sissejuhatus lihtsasse lineaarsesse regressiooni

Sõnastikust : naasmine endisesse või vähem arenenud olekusse.

Statistika osas: ühe muutuja keskmise väärtuse ja teiste muutujate vastavate väärtuste vahelise seose mõõt.

Regressiooni, milles sisendmuutuja (sõltumatu muutuja) ja sihtmuutuja (sõltuva muutuja) vahelist suhet peetakse lineaarseks, nimetatakse lineaarseks regressiooniks. Lihtne lineaarne regressioon on lineaarse regressiooni tüüp, kus sõltuva muutuja ennustamiseks on meil ainult üks sõltumatu muutuja. Lihtne lineaarne regressioon on üks masinõppe algoritme. Lihtne lineaarne regressioon kuulub juhendatud õppe perekonda. Pidevate väärtuste ennustamiseks kasutatakse regressiooni.

Lihtsa lineaarse regressiooni mudel

Teeme selle lihtsaks. Kuidas see kõik alguse sai?

Kõik sai alguse 1800. aastal Francis Galtoniga. Ta uuris isade ja nende poegade vahelisi suhteid pikkusega. Ta jälgis mustrit: kummagi poja pikkus oleks sama pikk, kui isa või poja kõrgus kipub olema lähemal kõigi inimeste keskmisele keskmisele kõrgusele. See nähtus pole midagi muud kui regressioon.

Näiteks Shaq O'Neal on väga kuulus NBA mängija ja on 2, 16 meetrit pikk. Tema pojad Shaqir ja Shareef O'neal on vastavalt 1, 96 ja 2, 06 meetrit pikad. Rahvastiku keskmine kõrgus on 1, 76 meetrit. Poja kõrguse regress (triiv suunas) keskmise kõrguse.

Kuidas toimub regressioon?

Ainult kahe andmepunktiga regressiooni arvutamine:

Parima regressiooni leidmiseks tahame vaid tõmmata joonele, mis on võimalikult lähedal igale punktile. Kahe andmepunkti korral on lihtne joon tõmmata, lihtsalt ühendage need.

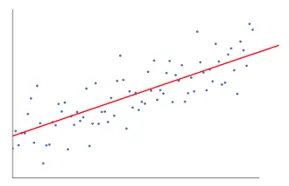

Kui meil on nüüd arvukalt andmepunkte, kuidas tõmmata igale andmepunktile võimalikult lähedal olev joon,

Sel juhul on meie eesmärk minimeerida joone ja kõigi andmepunktide vertikaalset kaugust. Sel viisil ennustame oma Lineaarse regressioonimudeli jaoks parimat joont.

Mida tähendab lihtne lineaarne regressioon?

Allpool on toodud üksikasjalik selgitus lihtsa lineaarse regressiooni kohta:

- See joonistab palju ja palju võimalikke jooni ja teeb seejärel selle analüüsi.

- Ruutude vigade summa.

- Absoluutsete vigade summa.

- väikseima ruudu meetod … jne

- Analüüsiks kasutame väikseima ruudu meetodit.

- Teeme kõik punktid vahet ja arvutame kõigi punktide summa ruudu. Kumb rida annab minimaalse summa, on meie parim rida.

Näide: seda tehes võiksime võtta mitu meest ja nende poja pikkuse ning teha näiteks öelda mehele, kui pikk tema poeg võiks olla. enne kui ta isegi sündis.

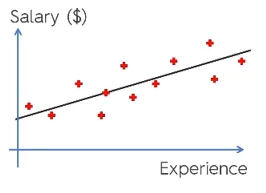

Google'i pilt

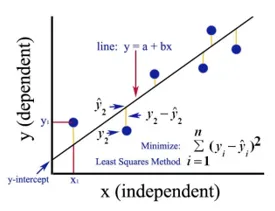

Ülaltoodud joonis näitab lihtsat lineaarset regressiooni. Joon tähistab regressioonijoont. Antud valemiga: y = a + b * x

Kus y on sõltuv muutuja (DV): Näiteks kuidas muutub inimese palk sõltuvalt töötaja kogemuse aastast. Nii et siin on töötaja või inimese palk teie sõltuv muutuja.

Sõltuv muutuja on meie sihtmuutuja, see, mida me tahame ennustada, kasutades lineaarset regressiooni.

x on meie sõltumatu muutuja (IV): sõltuv muutuja on sõltumatu muutuja põhjuseks. Ülaltoodud näites on kogemuste aastaarv meie sõltuv muutuja, kuna töötaja palga muutust põhjustab aastatepikkune kogemus.

- b on meie sõltumatu muutuja x koefitsientmuutuja. Sellel koefitsiendil on ülioluline roll. Selles öeldakse, kuidas x (IV) ühiku muutus mõjutab y (DV). Seda nimetatakse ka proportsionaalseks koefitsiendiks. Matemaatika osas on teie ülesandeks sirge kalle või võite öelda joone järsk.

- Meie näites, kui kalle (b) on väiksem, tähendab see, et aastate arv annab teisalt palga juurdekasvu vähem, kui kalle (b) on suurem, suureneb palk märkimisväärselt, suurenedes aastate kogemus.

- a on püsiv väärtus. Seda nimetatakse ka pealtkuulamiseks, st see, kus joon ristub y-telje või DV-teljega. Muul viisil võime öelda, kui töötajal on null aastat kogemust (x), siis on selle töötaja palk (y) püsiv (a).

Kuidas Least Square töötab?

Allpool on toodud punktid väikseima ruudukujulise töö jaoks:

- See tõmbab vastavalt suundumustele meelevaldse joone.

- See võtab andmepunkte ja joonistab vertikaalseid jooni. Ta peab parameetriks vertikaalset vahemaad.

- Need vertikaalsed jooned lõikavad regressioonisirge ja annavad andmepunktidele vastava punkti.

- Seejärel leiab ta vertikaalse erinevuse iga andmepunkti ja sellele vastava regressioonijoone andmepunkti vahel.

- See arvutab vea, mis on erinevuse ruut.

- Seejärel arvutab see vigade summa.

- Siis tõmbab jällegi joone alla ja kordab veel kord ülaltoodud protseduuri.

- Sel viisil tõmmatakse mitu rida ja parimaks reaks valitakse joon, mis annab kõige vähem viga.

- See parim joon on meie lihtne lineaarse regressioonisirge.

Lihtsa lineaarse regressiooni rakendamine

Pideva muutuja ennustamiseks tehakse regressioonanalüüs. Regressioonianalüüsil on lai valik rakendusi. Mõned näited on järgmised:

- Ennustav analüüs

- Turunduse tõhusus,

- mis tahes kirje hinnakujundus

- toote reklaamimise ennustus.

Siin käsitleme ennustava analüütika lineaarse regressiooni ühte rakendust. Teeme modelleerimise python abil.

Sammud, mida oma mudeli loomiseks järgime, on järgmised:

- Impordime raamatukogud ja andmekogumid.

- Me töötleme andmeid eeltöötluseks.

- Jagame andmed testkomplekti ja treeningkomplekti.

- Loome mudeli, mis püüab meie treeningkomplekti põhjal ennustada sihtmuutujat

- Ennustame testkomplekti sihtmuutuja.

- Analüüsime mudeli ennustatud tulemusi

Analüüsiks kasutame 30 töötaja andmetega palgaandmeid.

# Raamatukogude importimine

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

# Andmekogumi importimine (andmete näidis on esitatud tabelis)

dataset = pd.read_csv('Salary_Data.csv')

| Aastatepikkune kogemus | Palk |

| 1.5 | 37731 |

| 1.1 | 39343 |

| 2.2 | 39891 |

| 2 | 43525 |

| 1.3 | 46205 |

| 3.2 | 54445 |

| 4 | 55749 |

# Andmekogumi eeltöötlemine, jagame siin andmekogumi sõltuvaks muutujaks ja sõltumatuks muutujaks. x sõltumatu ja y sõltuva või sihtmuutujana

X = dataset.iloc(:, :-1).values

y = dataset.iloc(:, 1).values

# Andmekogumi jagamine treeningkomplekti ja testikomplekti:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 1/3, random_state = 0)

Testi suurus 1/3 näitab, et koguandmetest 2/3 on osa mudeli treenimiseks ja ülejäänud 1/3 kasutatakse mudeli testimiseks.

# Sobitume oma lihtsa lineaarse regressiooni mudeli treeningkomplektiga

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, y_train)

Lineaarse regressiooni mudelit treenitakse nüüd. Seda mudelit kasutatakse sõltuva muutuja ennustamiseks.

# Testikomplekti tulemuste ennustamine

y_pred = regressor.predict(X_test)

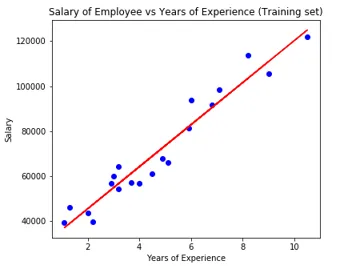

# Testikomplekti tulemuste visualiseerimine

plt.scatter(X_test, y_test, color = 'blue')

plt.plot(X_train, regressor.predict(X_train), color = 'red')

plt.title('Salary of Employee vs Experience (Test set)')

plt.xlabel('Years of Experience')

plt.ylabel('Salary')

plt.show()

# Mudeli parameeter

print(regressor.intercept_)

print(regressor.coef_)

26816.19224403119

(9345.94244312)

Nii et pealtkuulaja (a) väärtus on 26816. Mis viitab sellele, et värskem (null kogemus) saaks palgana umbes 26816 summa.

Meie mudeli koefitsient tuli välja kui 9345.94. See soovitab, et kui hoida kõik muud parameetrid muutumatuna, toob sõltumatu muutuja ühe ühiku muutus (näit. Aastad) palga muutuse 9345 ühikut.

Regressiooni hindamise mõõdikud

Regressioonianalüüsiks on põhimõtteliselt saadaval 3 olulist hindamismõõdiku meetodit:

- Keskmine absoluutne viga (MAE): see näitab absoluutsete vigade keskmist, mis on erinevus ennustatud ja tegeliku vahel.

- Keskmine ruutviga (MSE): näitab ruutude vigade keskmist väärtust.

- Ruutkeskmine ruutviga (RMSE): näitab ruutude keskmiste ruutjuure.

Võime ülaltoodud meetodeid võrrelda:

- MAE: see näitab keskmist viga ja kõigi kolme meetodi seast kõige lihtsamat.

- MSE: see on populaarsem kui MAE, kuna see suurendab suuremaid vigu, mille tulemusel kuvatakse rohkem teadmisi.

- RMSE: see on parem kui MSE, kuna saame viga y-ga tõlgendada.

Need 3 pole midagi muud kui kadumisfunktsioonid.

# Mudeli hindamine

from sklearn import metrics

print('MAE:', metrics.mean_absolute_error(y_test, y_pred))

print('MSE:', metrics.mean_squared_error(y_test, y_pred))

print('RMSE:', np.sqrt(metrics.mean_squared_error(y_test, y_pred)))

MAE: 3426.4269374307123

MSE: 21026037.329511296

RMSE: 4585.4157204675885

Järeldus

Lineaarse regressiooni analüüs on masinõppe algoritmide võimas tööriist, mida kasutatakse selliste pidevate muutujate nagu palk, müük, jõudlus jne ennustamiseks. Lineaarse regressiooniga arvestatakse lineaarset suhet sõltumatute ja sõltuvate muutujate vahel. Lihtsal lineaarsel regressioonil on ainult üks sõltumatu muutuja, mille põhjal mudel ennustab sihtmuutujat. Oleme arutanud lineaarse regressiooni mudelit ja rakendamist ennustava analüüsi näitega töötajate palga ennustamiseks.

Soovitatavad artiklid

See on lihtsa lineaarse regressiooni juhend. Siin käsitleme lineaarse regressiooni mudelit ja rakendamist, kasutades ennustava analüüsi näidet töötajate palkade ennustamiseks. Lisateavet leiate ka meie muudest seotud artiklitest -

- Lineaarse regressiooni analüüs

- Lineaarne regressioon R-s

- Lineaarse regressiooni modelleerimine

- Regressioonitesti tööriistad

- Matplotlib Pythonis | Matplotlibi 14 parimat krunti

- Sõnastik Pythonis | Meetodid ja näited

- Näited ruutjuurest PHP-s

- Lineaarne regressioon vs logistiline regressioon | Peamised erinevused