Sissejuhatus masinõppe algoritmide tüüpidesse

Masinõppe algoritmi tüübid või AI-arvutused on programmid (matemaatika ja põhjendus), mis muudavad end paremini toimima, kuna neile esitatakse rohkem teavet. AI mõne osa “kohandamine” tähendab, et need projektid muudavad teabe töötlemise viise mõne aja pärast, sama palju kui inimesed muudavad seda, kuidas nad teavet õpivad. Nii et masinõppimine või AI arvutamine on programm, millel on konkreetne meetod enda parameetrite muutmiseks, arvestades kriitikat tema varasemate näitusetegemise ootuste osas andmekogumi suhtes.

Kõik tüüpi masinõppe algoritmid

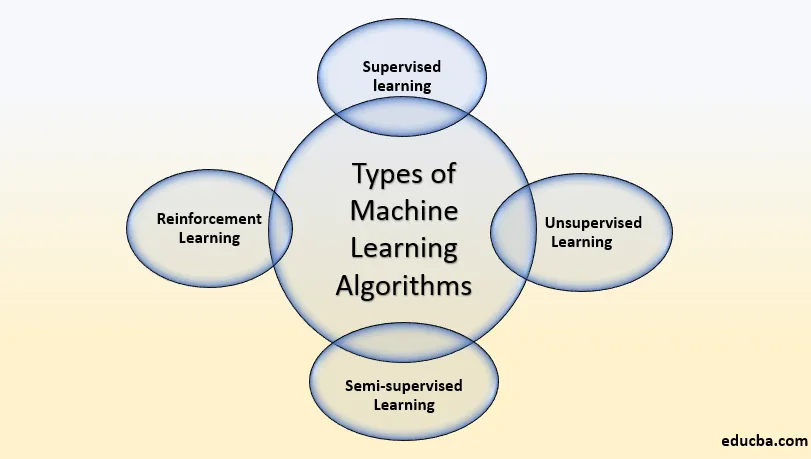

Nende teatud variandid masinõppe algoritmide tüüpide iseloomustamiseks, kuid tavaliselt saab neid motivatsiooni järgi klassidesse jaotada ning põhimõttelised klassifikatsioonid on sellega kaasas:

- Juhendatud õppimine

- Juhendamata õppimine

- Pooljuhendatud õpe

- Tugevdusõpe

Mis on juhendatud õpe

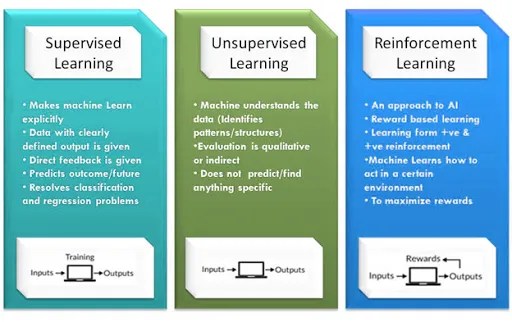

Juhendatud õpe on koht, kus võite arvestada, et õppimist juhendab õpetaja. Meil on andmekogu, mis töötab välja koolitajana ja selle ülesandeks on mudeli või masina ettevalmistamine. Kui mudel on ettevalmistatud, võib see uue teabe saamise korral asuda ootuste või valiku ees seisma.

Juhendatud õppe näide:

- Saate palju fotosid andmetega nende kohta, mis neil on, ja pärast seda koolitate mudelit uute fotode tajumiseks.

- Kui teil on majade hindade kohta nende suuruse ja asukoha põhjal palju andmeid, sisestate selle mudelisse ja koolitate, siis saate ennustada teiste majade hindu teie sisestatud andmete põhjal.

- Kui soovite ennustada, et teie kiri on rämpspost või ei põhine vanemal kirjal, võite ennustada, et uus kiri on rämpspost või mitte.

Juhendatud õppe algoritm on järgmine:

1) Lineaarne regressioon

lineaarne regressioon on väärtuslik seose avastamiseks kahe püsiva teguri vahel. Üks on ennustaja või autonoomne muutuja ja teine on reaktsiooni või koguduse muutuja. See otsib mõõdetavat suhet, kuid mitte deterministlikku suhet. Väidetavalt on kahe teguri vaheline seos determinantne, kuna ühe muutuja saab teine täpselt edastada. Kasutades näiteks temperatuuri Celsiuse kraadides, on mõeldav täpselt ette näha Fahrenheit. Tegelik seos ei ole kahe teguri vahelise seose määramisel täpne. Näiteks ühendus kuskil pikkuse ja raskuse vahemikus. Keskseks mõtteks on saada rida, mis sobib kõige paremini teabega. Kõige sobivam joon on see, mille jaoks on prognoosiviga (kogu teabe fookus) nii väike, kui antud olukorras võiks eeldada. Viga on punkt regressioonijoone eraldamisel.

2) otsustuspuud

Otsustuspuu on otsuste abistamise vidin, mis kasutab puudeta diagrammi või otsuste mudelit ja nende potentsiaalseid tulemusi, sealhulgas juhuslike sündmuste tulemusi, ressursikulusid ja utiliiti. Uurige pilti, et saada tunne, mida see sarnaneb.

3) Naiivsete Bayesi klassifikatsioon

Naive Bayes liigitab peamiste tõenäosuslike klassifikaatorite rühma, mis sõltub Bayesi teooria rakendamisest tugeva (keeruka) enesejuhtimisega, Naive Bayes'i tunnusjoontest. See klassifikatsioon Mõned sertifitseeritavad mudelid on:

E-kirja tembeldamine rämpspostiks või mitte rämpspostiks

Tellige uudislugu innovatsiooni, valitsuse probleemide või spordi kohta

Kontrollige, kas aine puudutab positiivseid emotsioone või negatiivseid tundeid?

Kasutatakse näotuvastuse programmeerimiseks.

4) logistiline regressioon

Logistiline regressioon on murranguline faktiline meetod binoomitulemuse demonstreerimiseks vähemalt ühe informatiivse teguriga. See kvantifitseerib seose absoluutse eestikeelse muutuja ja vähemalt ühe vaba teguri vahel, hinnates tõenäosusi logistilise võimekuse abil, mis on kombineeritud logistiline assigneering.

Tavaliselt on regressioonid reaalses elus kasutatavad nagu:

Krediidiskoor

Turu või ettevõtte edukuse näitaja

Mis tahes ettevõtte või toote tulude prognoosimiseks

Kas igal päeval toimub maavärin?

5) Tavaline vähimruutude regressioon

Vähimad ruudud on strateegia otsese regressiooni teostamiseks. otsene regressioon on ettevõtmine paigaldada rida läbi paljude fookuste. Selle jaoks on mitu potentsiaalset protseduuri ja “tavaliste väikseimate ruutude” süsteem kulgeb järgmiselt - võite tõmmata joone ja pärast seda kõigi andmekeskuste jaoks mõõta punkti ja joone vahelist vertikaalset eraldumist ning lisada need üles; paigaldatud joon oleks koht, kus see vaheseinte kogum on nii napp, kui praegust olukorda arvestades tavaline olla võiks.

Mis on juhendamata õpe?

Mudel õpib tajumise kaudu ja avastab infostruktuurid. Kui mudelile antakse andmekogum, avastab ta sellest tulenevalt andmekogumis näited ja ühendused, tehes sinna kimpu. Mida see teha ei saa, on hunnikule märkide lisamine, sarnaselt sellega ei saa öelda, et see on õunte või mangode kogunemine, kuid see isoleerib iga õuna mangost.

Oletame, et näitasime mudelile pilte õuntest, banaanidest ja mangodest, nii et mida see teeb, teatud näiteid ja seoseid silmas pidades, teeb kobarad ja partitsioonid andmekogu nendesse rühmadesse. Praegu, kui mudelile on lisatud muud teavet, lisab see selle ühele valmistatud kimpu.

Näide juhendamata õppimisest

- Teil on palju 6 inimese fotosid, kuid puuduvad andmed selle kohta, kelle peal keegi asub, ja peate selle andmestiku eraldama 6 hunnikusse, millest igaühel on ühe inimese fotod.

- Teil on osakesi, osa neist on ravimid ja osa mitte, aga te ei tea, milline neist on ja ravimite leidmiseks on vaja arvutust.

Juhendamata õppe algoritm on järgmine

Klastrid

Klastrite loomine on oluline mõte abita õppimise osas. Enamasti õnnestub kategooriateta teabe kogumisel leida struktuur või näide. Klastriarvutused töötlevad teie teavet ja avastavad iseloomulikud klastrid (rühmad) juhul, kui need on teabes olemas. Samuti saate muuta, mitu kimpu teie arvutused peaksid eristama. See võimaldab teil muuta nende kogunemiste detailsust.

Võite kasutada erinevaid rühmitusi

- Valikuline (jaotatav)

- Mudel: K-tähendab

- Aglomeratiivne

- Mudel: hierarhiline klasterdamine

- Mis hõlmab

- Mudel: hägusad C-vahendid

- Tõenäoline

Klasterdamisalgoritmi tüübid

- Hierarhiline rühmitus

- K tähendab rühmitust

- K-NN (k lähimat naabrit)

- Põhikomponentide analüüs

- Üksikväärtuse lagunemine

- Komponentide sõltumatu analüüs

- Hierarhiline klasterdamine

Hierarhiline klasterdamine

Hierarhiline rühmitamine on arvutus, mis konstrueerib rühmade nokkimise järjekorra. See algab igast teabest, mis on välja antud nende enda hunnikule. Siin on kaks lähedast rühma sarnases kobaras. See arvutus suletakse, kui alles on jäänud ainult üks rühm.

K-tähendab klastrit

K tähendab, et see on iteratiivne rühmitusarvutus, mis julgustab leidma iga rõhuasetuse jaoks kõige tähelepanuväärsem stiimul. Alguses valitakse ideaalne rühmade arv. Selles rühmitamistehnikas peate koondama teavet, mis keskendub k kogunemisele. Suurem k tähendab väiksemate kogunemistega sarnaselt ka suuremat detailsust. Madalam k tähendab suuremaid koosviibimisi väiksema detailsusega.

Arvutuse tulemuseks on „nimede” kogumine. See võimaldab teabejuhti ühele k kogunemisest. K-vahendite rühmitamisel iseloomustab iga kogunemine iga kogunemise jaoks keskpunkti tegemist. Tsentroidid on nagu hunnik, mis püüab neile lähimad fookused kinni ja lisab nad rühma.

K-keskmine rühmitus iseloomustab veel kahte alarühma

- Aglomeratiivne klasterdamine

- Dendrogramm

Aglomeratiivne klasterdamine

Selline K-vahendite rühmitamine algab kindla arvu kimpudega. See määrab kogu teabe täpseks rühmaks. See rühmitusstrateegia ei nõua rühmade K arvu infos. Aglomeratsiooniprotseduur algab iga nullpunkti moodustamisega üksikuna.

See strateegia kasutab mõnda eraldusmõõtu, vähendab protsessi ühendamise teel kobarate arvu (üks igas rõhuasetuses). Kokkuvõtteks võib öelda, et meil on üks suur rühm, mis sisaldab kõiki artikleid.

Dendrogramm

Dendrogrami rühmitustehnikas räägib iga tase mõeldava rühmana. Dendrogrammi kõrgus näitab kahe ühenduskobara vahelise sarnasuse astet. Menetluse alusele lähemal on nad järk-järgult võrreldav kamp, mis on dendrogrammist kogumise leid, mis pole iseloomulik ja enamasti abstraktne.

K-Lähimad naabrid

K-lähim naaber on kõigist AI klassifikaatoritest kõige sirgem. See erineb teistest AI protseduuridest selles osas, et ei anna mudelit. See on lihtne arvutus, mis salvestab kõik kättesaadavad juhtumid ja iseloomustab uusi näiteid, mis sõltuvad sarnasuse mõõtmest.

See töötab väga hästi, kui mudeleid eristatakse. Õppimisaste on mõõdukas, kui ettevalmistuskomplekt on tohutu ning eraldusfiguur on mittetriviaalne.

Põhikomponentide analüüs

Võimalik, et vajate kõrgema mõõtmega ruumi. Peate valima selle ruumi põhjuse ja just selle eelduse 200 kõige olulisemat partituuri. Seda alust tuntakse põhikomponendina. Teie valitud alamhulk on veel üks ruum, mille suurus on vastandatud ainulaadsele ruumile. See hoiab siiski kinni teabe mitmetahulisest olemusest, nagu võiks eeldada.

Mis on tugevdusõpe?

See on spetsialisti võime teha maaga koostööd ja avastada, mis on parim tulemus. See järgib löögi ja esialgse tehnika ideed. Operaatorile makstakse tasu või selle eest karistatakse punktiga õiguse või mittepõhise vastuse eest ning positiivse tasu põhjal keskendub valitud mudel ise valitud rongidele. Samuti valmistub see taas kord ette nägema talle tutvustatud uut teavet.

Näide tugevdusõppest

- Kuulutuste kuvamine vastavalt kasutaja soovidele ei meeldi pikaks ajaks

- Teage reaalajas kasutatavat reklaamieelarvet

- vastupidine tugevdamine, et õppida tundma kliente, kellele see ei meeldi

Mis on pooljuhendatud õpe?

Pooljärelevalvelise õppe korral arvutatakse arvutisse nimetamata ja sildistamata teabe põhjal. Tavaliselt sisaldab see segu piiratud koguses nimega teavet ja palju sildistamata teavet. Kaasatud põhimeetod on see, et esiteks, tarkvarainsener grupeerib võrreldava teabe, kasutades ilma abita arvutuslikke andmeid, ja seejärel kasutab praegust nime kantud teavet ülejäänud märgistamata teabe nimetamiseks. Sellise arvutuse tavakasutusnäidetel on nende hulgas tüüpiline omadus - sildistamata teabe saamine on üldiselt tagasihoidlik, samas kui nimetatud teabe nimetamine on üle kõige kallis. Loomulikult võib ette kujutada kolme tüüpi õppearvestusi juhendatavatena, realiseerides juhul, kui alauuring on juhendaja juhendamisel nii kodus kui ka koolis, juhendamata, kui alauuringul tuleb ideest aru saada ja pooljuhendatud realiseerimisel, kus koolitaja näitab klassis paar ideed ja annab koolitööna järelepärimisi, mis sõltuvad võrreldavatest ideedest.

Pooljuhendatud õppe näide

On silmapaistev, et rohkem teavet = parema kvaliteediga mudelid põhjalikus õppes (kuni kindla piirimiseni selgelt, kuid enamasti pole meil nii palju teavet.) Olgu kuidas on, tähistatud teabe saamine on kulukas. Juhul, kui peate tiibadega loomade eristamiseks mudeli ette valmistama, saate lindude järelt pildistamiseks seadistada palju kaameraid. See on üldiselt tagasihoidlik. Nende fotode märkimiseks lepingute sõlmimine on kulukas. Mõelge võimalusele, et teil on tohutul hulgal pilte tiivastest loomadest, kuid sõlmige üksikisikutega leping ainult fotode väiksema alamrühma märkimiseks. Nagu selgus, võite selle asemel, et lihtsalt tähistatud alamhulgal mudeleid treenida, saate mudeli eelkoolitada kogu treeningkomplektiga, enne kui kohandada seda nimetatud alamhulgaga, ja näidata nende parandamise märke. See on pooljuhendatud õpe. See paneb teie raha kõrvale.

Järeldus

Seal on palju tüüpi masinõppe algoritme ja erinevatel tingimustel peame parima tulemuse saamiseks kasutama kõige paremini sobivat algoritmi. On palju algoritme, mis leiavad iga masinõppe algoritmi tüübi parima täpsuse ja mis on selle algoritmi kasutamisel kõige täpsem. Saame minimeerida iga algoritmi viga, vähendades andmete müra. Lõpuks ütlen, et pole ühtegi masinõppe algoritmi, mis annaks teile 100-protsendilise täpsuse, isegi kui inimese aju ei suuda seda teha, nii et leidke oma andmetele parim kuuse algoritm.

Soovitatavad artiklid

See on juhend masinõppe algoritmide tüüpidele. Siin räägime sellest, mis on masinõppe algoritm? Selle tüübid hõlmavad juhendatud õppimist, juhendamata õppimist, pooljuhendatud õppimist, tugevdusõpet. Lisateabe saamiseks võite vaadata ka järgmisi artikleid -

- Masinõppe meetodid

- Masinõppe raamatukogud

- Masinõppe mudelid

- Masinõppe raamistikud

- Hüperparameetri masinõpe

- Hierarhiline rühmitus | Aglomeratiivne ja lõhestav klasterdamine

- Loo otsustuspuu | Kuidas luua | Eelised

- Masinõppe elutsükkel | 8 parimat etappi